2025年6月6日至7日,在北京智源大会上,银河通用机器人正式发布了全球首个开源视觉语言动作(VLA)大模型GroceryVLA,这标志着零售行业机器人技术的重大突破。

核心特点与技术亮点

GroceryVLA是一款专为零售场景设计的端到端具身大模型,具有以下显著特性:

- 多模态融合能力:整合了视觉感知、语言理解和动作执行三大模块,实现从感知到动作的闭环控制

- 开源特性:作为全球首个开源的零售VLA大模型,将推动整个行业的技术进步

- 真实场景验证:在1:1还原的真实商超场景中展示复杂货架抓取与交付的全流程自主执行能力

- 零样本泛化:具备纯视觉环境感知和语言指令驱动能力,无需特定场景训练即可执行新任务

现场演示表现

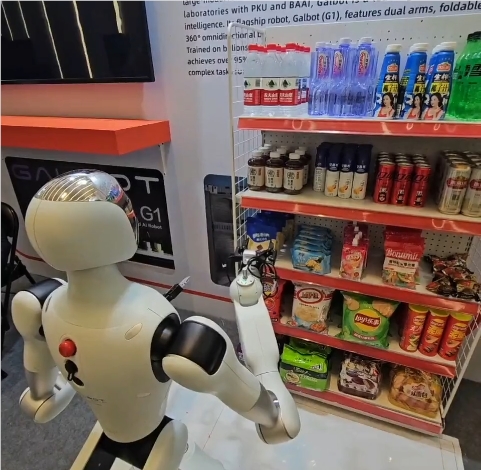

在大会开幕式上,银河通用机器人Galbot G1展示了令人印象深刻的能力:

- 在真实的商超环境中实现无人遥控的自主操作

- 精准识别和抓取货架上的商品

- 理解自然语言指令并转化为相应动作

- 处理复杂环境和动态障碍物

技术背景与行业影响

GroceryVLA建立在Llama2语言模型基础上,融合了DINOv2和SigLIP预训练特征的视觉编码器。这一发布代表了VLA技术从实验室走向实际商业应用的重要里程碑,特别是在以下方面:

- 为零售行业提供智能化的库存管理和客户服务解决方案

- 降低机器人部署门槛,通过开源促进生态发展

- 展示具身智能在复杂物理环境中的实际应用潜力

相关技术生态

银河通用同时开源了OpenWBT(Whole Body Teleoperation)系统,这是一套完整的机器人遥操作框架,包括:

- 全身动作捕捉与映射技术

- 实时远程控制系统

- 多模态反馈接口

这一系列技术发布预示着具身智能正在加速进入商业化应用阶段,特别是在零售、物流等需要高度灵活性的服务场景中。

© 版权声明

文章收集自互联网,如有侵权,请联系删除